Nos encantan las IAs, pero no están listas. En sus pasos para evolucionar comete errores y prácticas poco éticas. Los medios son algunos de los afectados aunque haya acuerdos mediantes.

(Texto publicado originalmente en «Newsletter»).

Estamos fascinados con la inteligencia artificial. En segundos puede generar una imagen o devolvernos un texto sobre cualquier tema. Puede automatizar un proceso que podría llevar horas de trabajo o asistirnos en nuestras tareas para producir en menos tiempo.

En mi caso, todavía no dejo de sorprenderme. Las piezas de video generadas con AI me resultan geniales. Sé que en todos los órdenes de uso, estamos en el inicio. Lo dicen los analistas y lo dicen sus creadores. Esto recién empieza.

En el caso de los medios puede ser que estos inicios no sean los mejores.

Ya hemos visto unos cuántos errores de sesgo e interpretación que han arrojado algunas AI como Gemini de Google o ChatGPT. No voy a enumerar todo ahora, pero si estuvieron atentos en los últimos meses se habrán enterado de unas cuantas. Lo de ponerle pegamento a la mezcla de una pizza casera, para mí fue la más graciosa.

Luego está el robo de contenido. En su afán por presentar resultados actualizados y obtener datos de la forma que sea, algunas plataformas avanzan como sea. El escándalo de hace dos semanas fue el uso sin permiso de contenido que hizo Perplexity a Forbes.

“Mi informe confirma que ChatGPT está alucinando URLs de al menos otras 10 publicaciones que forman parte de los acuerdos de licencia en curso de OpenAI”, dice Andews Deck de Nieman Lab en un artículo.

No deben estar muy contentos los medios que acordaron con OpenAI el uso de contenidos. No citar bien las fuentes, utilizar mal la información que se ofrece a los usuarios (cuando digo ‘mal’ digo tergiversar) y extraer textos sin permisos; generan un combo que no es el que esperábamos.

Más aun. Quienes quieren información rigurosa y confiable deben contrastar los resultados que ofrecen las herramientas de inteligencia artificial. Tantos errores empujan a tener que buscar la fuente y chequear. Pero ya sabemos que chequear y verificar es para una minoría.

Otra metida de pata es deliberadamente usar las herramientas para robar contenido. Nada que no pueda hacerse sin las IA pero ahora acelerado, en serie y en volúmenes infinitos. El mejor caso que ejemplifica esta situación están en 404media. Un periodista de ese medio gastó 365 dólares y monedas para hacer un sitio de tecnología que tomara contenido del suyo y de otros referentes de tecnología. Todo con WordPress y algunos plugins. La conexión a ChatGPT le sirve para “remezclar” los artículos y generar “nuevos” a gran escala. ¿Hay periodismo ahí? No. Es content-spam, pero paladares poco exigentes pueden considerarlo legítimo.

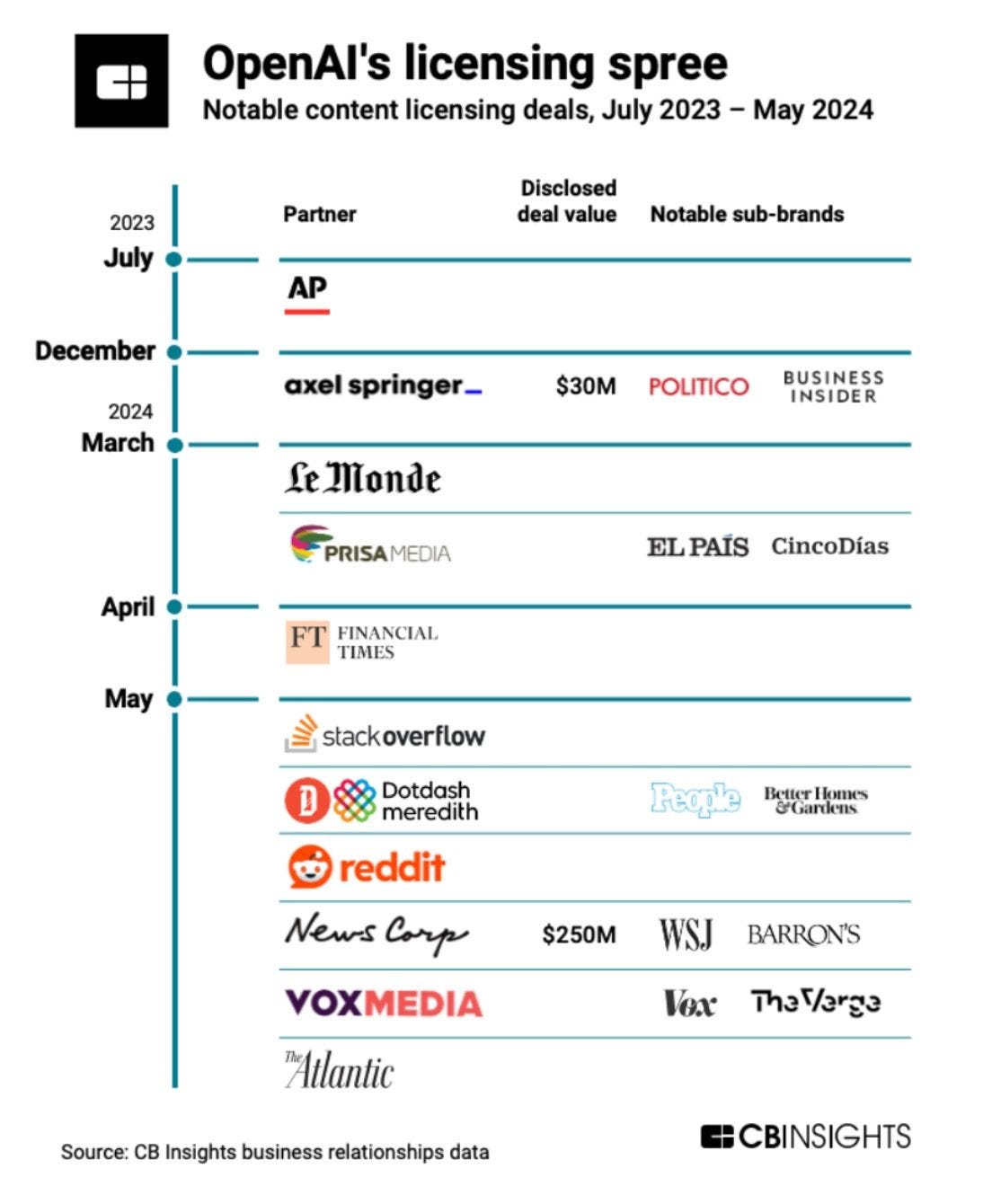

Hasta aquí hay una necesidad de alimentar las inteligencias artificiales con materia prima de calidad. De ahí que OpenAI llegue a acuerdos con tantos medios legacy del mundo. Al parecer los contenidos de los medios importan.

Falta que eso se perfeccione a usos éticos y respetuosos para las organizaciones de medios y la audiencia.

Extra Backlinks:

- A la lista de medios que ya acordaron con OpenAI para ceder sus contenidos, la noticia de la semana fue que se sumó Time. Nada menos que 101 años de historia de la icónica publicación. Anuncio oficial.

- Ismael Nafría publicó en su newsletter Tendencias la larga lista de medios que ya acordaron, con quién ya acordó OpenAI para ofrecer sus servicios y los que están en litigio.

- La BBC tiene datos de cuánta aceptación tiene la inteligencia artificial en el Reino Unido.

- El reciente informe de Reuters Institute dedica todo un apartado a la AI y su uso en el periodismo. Con datos de las encuestas, aceptación (o no), entre otros.

El nuevo acuerdo de Time debería sumarse al siguiente gráfico:

Deja un comentario